大家有没有想过,我们手机里的静态照片,未来不仅能动起来,还能“开口说话”?日前字节跳动发布了一项名为 INFP 的AI系统,可以让静态照片变成“会说话”的视频,效果十分逼真。

这是什么技术?

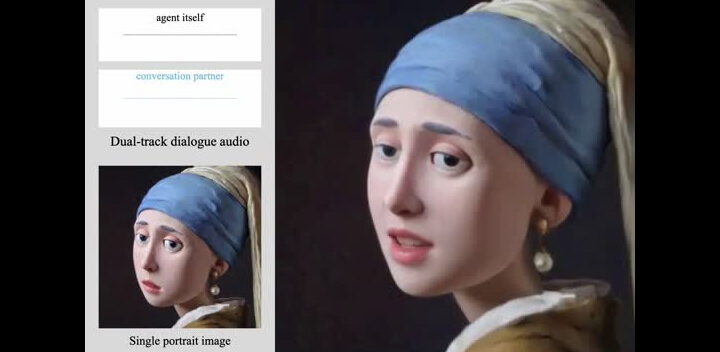

简单来说,INFP 是一个可以让照片“动”起来的AI系统,不仅嘴巴会跟着声音动,连表情、头部动作都很自然。更特别的是,它还能自动模拟两个人的对话,不需要手动设置谁是“说话者”或“倾听者”,AI会根据语音内容自动生成相应的动作和角色。

INFP 的全称是 “Interactive, Natural, Flash and Person-generic”(交互式、自然、快速和通用)。简单理解,这套系统的特点是生成效果自然、生成速度快,并且适用于多个场景。

它是怎么实现的?

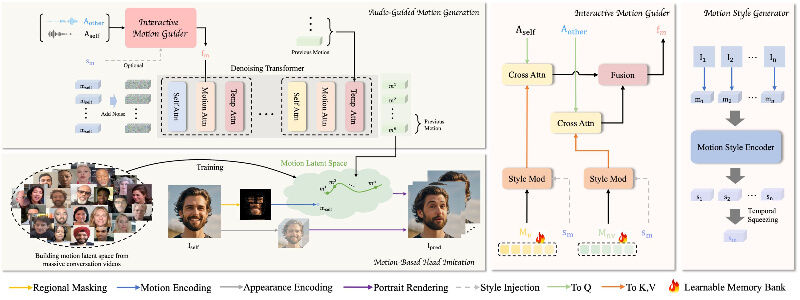

INFP的工作原理分为两步:

模仿动作:

![字节跳动新AI,让静态照片“开口说话”_2.jpg 字节跳动新AI,让静态照片“开口说话”_2.jpg]()

AI会从真人对话视频中学习人类交流时的各种细节,比如面部表情和头部动作。它将这些动作转化为数据,并应用到静态照片上,使照片看起来像是在动态“表演”。匹配声音:

![字节跳动新AI,让静态照片“开口说话”_1.jpg 字节跳动新AI,让静态照片“开口说话”_1.jpg]()

AI会根据输入的语音生成与之对应的嘴型和表情动作,同时还能模拟倾听时的表情和动作。系统中还包含一个“扩散变换器”,可以优化生成的动作,让整体效果更加自然流畅。

这项技术有什么优势?

与市面上的其他工具相比,INFP 在以下几个方面表现突出:

嘴型和语音匹配度高,生成的效果更加真实;

能够保留照片中人物的独特面部特征,不会出现失真或“变脸”;

不仅能生成说话动作,倾听时的表情和动作也处理得非常自然。

为了提升系统的表现,字节跳动还专门开发了一个高质量的数据集 DyConv,包含超过200小时的真人对话视频。这个数据集覆盖了更多样化的情感表达和动作细节,为AI的训练提供了更丰富的素材。

未来会有哪些应用?

目前,INFP 主要基于音频输入生成动态效果,但团队正在研究如何结合图像和文字输入,甚至探索生成全身动作的可能性未来或许只需一张静态照片,就可以生成一个完整的动态视频,用于聊天、录制短视频,甚至应用于虚拟形象的生成。

虽然目前这项技术还在研究阶段,但未来将会被应用到抖音等平台,为内容创作提供更多可能性。