Stable Diffusion XL模型也可以支持个性化视觉偏好了,在AI图像生成领域,个性化一直是一个备受关注的方向。我们已经看到Midjourney推出了Personalization功能,允许用户通过 "/prefer" 命令来调整生成结果。

现在由EPFL-VILAB团队开发的ViPer模型,也可以使 Stable Diffusion XL实现更加精准和个性化的AI图像生成,让AI生成的图像更符合用户的个人品味。

ViPer是如何工作的?

ViPer的核心理念是通过分析用户对一系列图片的详细评价,来学习和理解用户的视觉偏好。然后,它将这些偏好应用到图像生成过程中,创作出符合用户个人审美的作品。

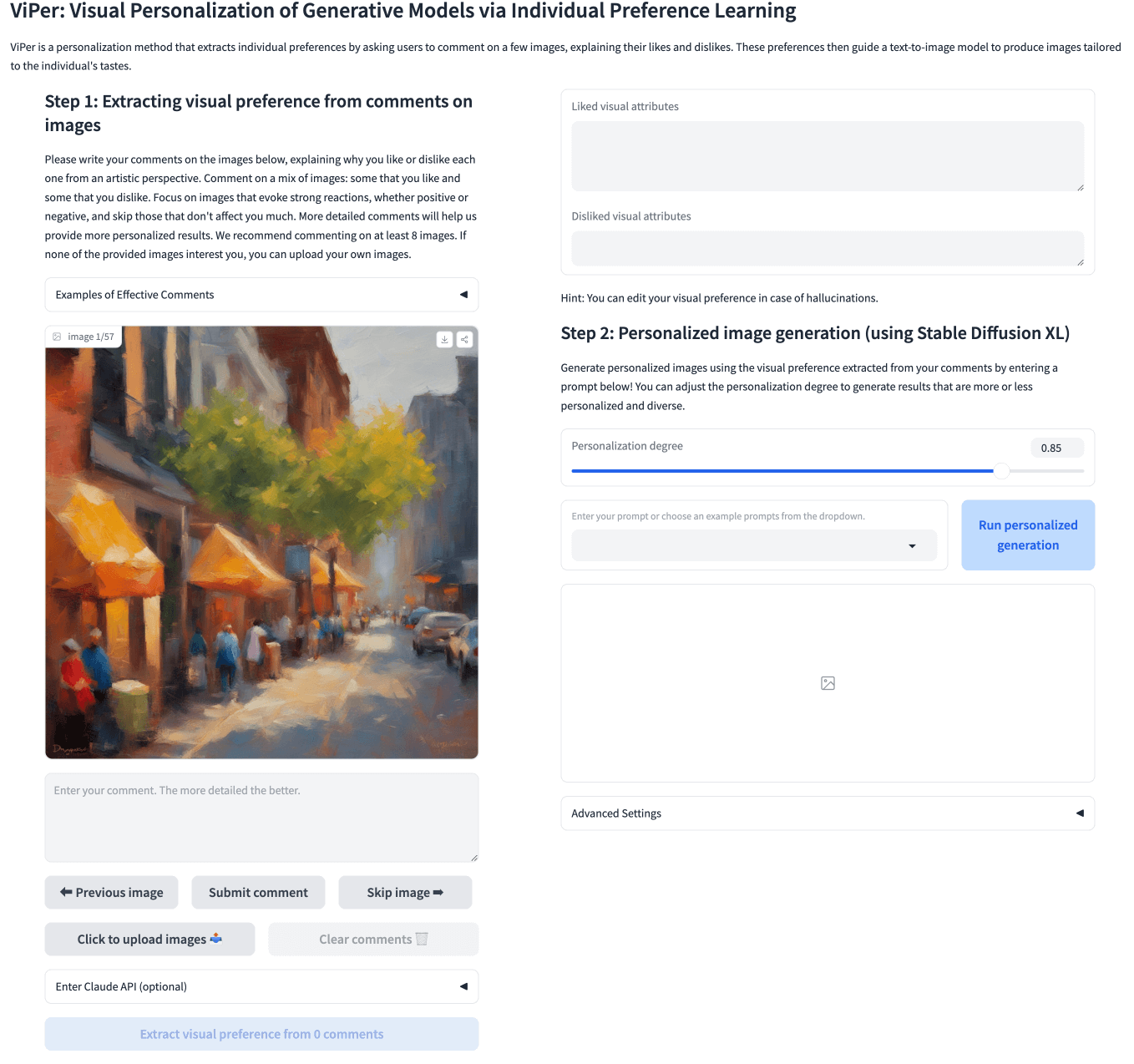

ViPer提供了一个在线demo,以下是使用ViPer在线demo的步骤:

访问ViPer Demo

打开浏览器,前往ViPer的Hugging Face空间:https://huggingface.co/spaces/EPFL-VILAB/ViPer视觉偏好提取

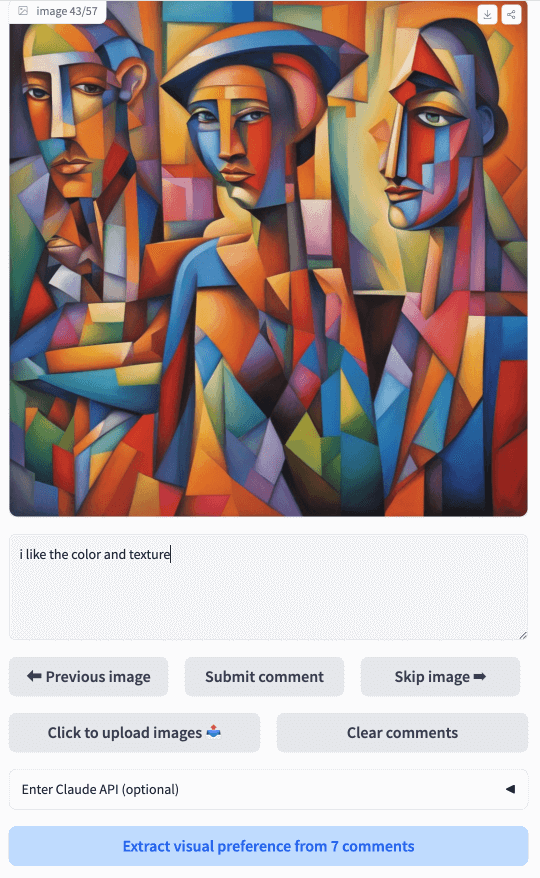

页面上会显示一系列多样化的图片。

仔细观察每张图片,并在评论框中详细描述你的感受。

例如:"这幅画的色彩非常温暖,给人一种舒适的感觉。我特别喜欢背景中柔和的光线效果。"

或者:"虽然构图很有趣,但这张图片的色调太冷了,不太符合我的喜好。"

尽可能详细地说明你喜欢或不喜欢的具体元素,如色彩、构图、风格等。

ViPer建议至少评论8张图片,这样系统才能全面准确地捕捉你的审美倾向。

![EPFL-VILAB:ViPer丨SD XL模型生成个性化审美偏好图像_2.png EPFL-VILAB:ViPer丨SD XL模型生成个性化审美偏好图像_2.png]()

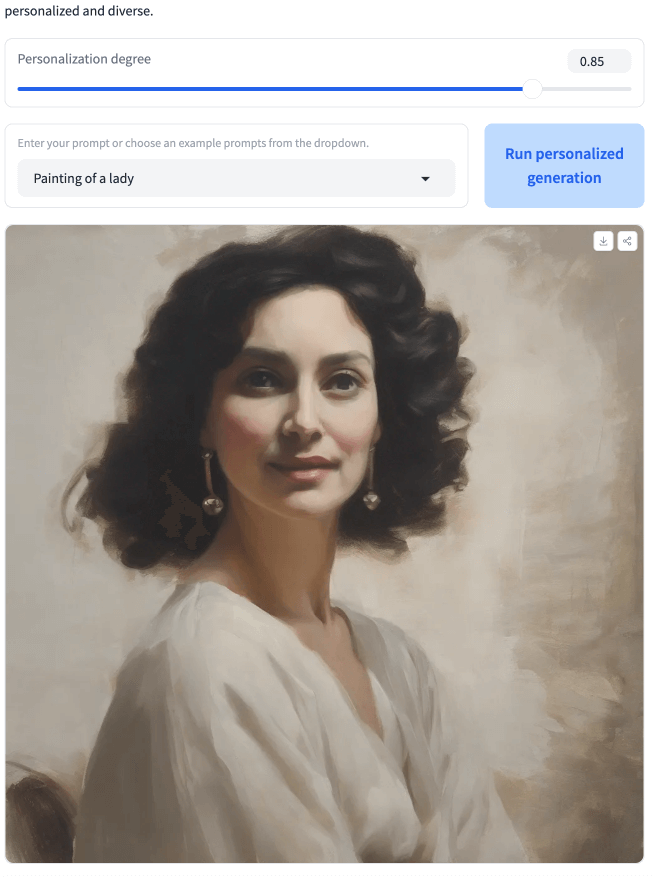

调整个性化程度

完成评论后,你会看到一个"Personalization degree"(个性化程度)的滑块。

通过调整这个滑块,你可以控制你的个人偏好对最终生成结果的影响强度。

![EPFL-VILAB:ViPer丨SD XL模型生成个性化审美偏好图像_3.png EPFL-VILAB:ViPer丨SD XL模型生成个性化审美偏好图像_3.png]()

生成个性化图像

在文本输入框中,输入你想要生成的图像描述。

例如,你可以输入"一个宁静的森林湖泊"或"繁华都市的夜景"。

点击"Run personalized generation"按钮,等待系统生成结果。

ViPer会根据你的文字描述和之前学习到的你的审美偏好,生成一系列图像。

这些图像不仅符合你的描述,还会融入你个人的审美风格。

与Midjourney的Personalization功能一样,ViPer代表了AI创作工具不断进步,试图更好地理解和满足用户需求的趋势。快去试试吧!