字节跳动日前被爆出一直在秘密使用OpenAI的GPT API来训练自己代号为“Project Seed”的大语言模型,此举直接违反了OpenAI的使用条款。

按照OpenAI的使用条款,其API输出的模型不能被用于开发任何与OpenAI产品服务竞争的AI系统。但字节跳动几乎在模型的每个开发阶段,包括训练和评估,都依赖GPT API,经常达到访问/使用API的最大限制。同时,它还通过一定的数据脱敏方式,试图掩盖使用证据。

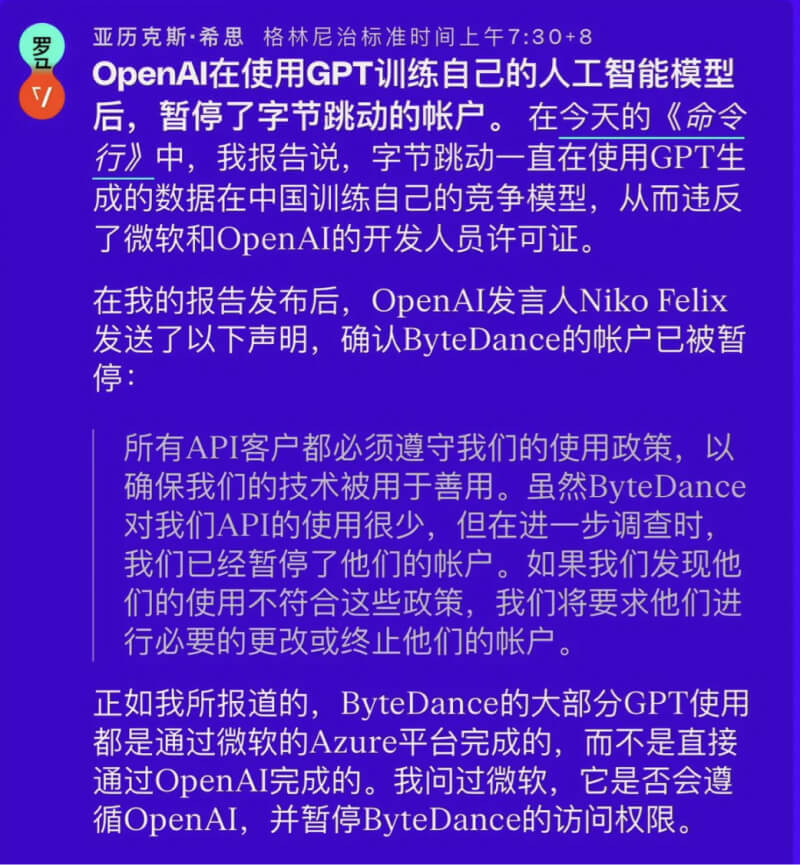

事件曝光后,OpenAI发言人迅速回应,确认已暂停字节跳动的相关账号。声明表示,所有API用户必须遵守使用政策,以确保技术用途正当。此事件正在调查,OpenAI已暂停字节跳动的账号。如果发现违规情况属实,将要求其纠正或终止账号。

字节跳动方面,发言人Jodi Seth声称,GPT生成数据只在早期用于模型训练,并在2019年中期删除。此外,字节跳动获得了微软的授权,可以通过GPT API支持非中国市场的产品,中国市场的产品使用自主开发模型。

相应地,微软发言人Frank Shaw发表声明予以否认,称并未对此做出授权,表示任何客户想使用微软AI服务,必须申请批准。微软还制定了标准,要求客户负责任地使用技术,并在发现违规时中止授权。

此事件也引发了人们对大语言模型安全的思考。大量语言模型之间相互训练构建新的模型,可能会导致错误信息传播被进一步放大。因为这些基础语言模型本身就是在非真实的人工数据上训练的,它们参与构建新的模型,可能会使最终模型与现实世界脱节,这是业内人士普遍担心的问题,最终可能导致我们对现实的判断偏离事实。

随着AI应用不断拓展,建立健全的伦理规范与监管机制刻不容缓。各方宜本着公开、透明的态度推动技术进步。